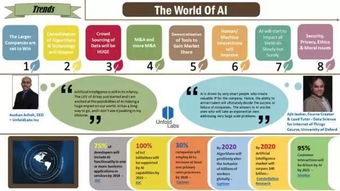

當阿爾法狗擊敗圍棋冠軍李世石時,人們驚嘆于人工智能的智慧;當ChatGPT寫出流暢文章時,人們開始憂慮創造性工作的未來;當Deepfake技術生成真假難辨的視頻時,一個根本性問題擺在我們面前:人工智能正在重新定義何為真實、何為道德、何為人類。

倫理爭議的四個引爆點

- 偏見放大器:人工智能系統依賴訓練數據,而數據往往反映著人類社會既有的偏見。美國某科技公司的人臉識別系統曾錯誤地將黑人識別為大猩猩;招聘算法被發現更傾向于選擇男性簡歷。這些并非算法本身有偏見,而是它放大了我們社會中已存在的不平等。開發者面臨拷問:我們是在建立更公平的世界,還是在用科技固化歧視?

- 隱私終結者:智能監控系統可以識別行人的每一步軌跡,語音助手可能在你不知情時記錄對話,個性化推薦算法比你自己更了解你的喜好。當便利與隱私成為交換條件,我們該劃清哪條界線?更令人不安的是,這些數據一旦被濫用,可能成為社會控制的工具。

- 責任真空區:自動駕駛汽車在不可避免的事故中該如何選擇?是保護車內乘客還是路人?當醫療診斷AI出現誤判導致患者死亡,責任在開發者、醫院還是算法本身?現有的法律框架難以應對這些新問題,形成了倫理與責任的灰色地帶。

- 人類性危機:當AI伴侶比真人更懂你的情緒,當虛擬偶像收獲千萬粉絲,當聊天機器人被用戶表白,我們不得不思考:人際關系是否正在被重新定義?如果機器能完美模擬情感,真實的人類連接價值何在?

開發者站在十字路口

人工智能開發者不再是單純的技術人員,他們實際上成為了隱形的倫理立法者。每一行代碼、每一個算法選擇都在塑造未來的社會形態。當前AI開發面臨三重困境:

- 商業利益與倫理的沖突:快速上市的壓力常使倫理考量被置于次要位置

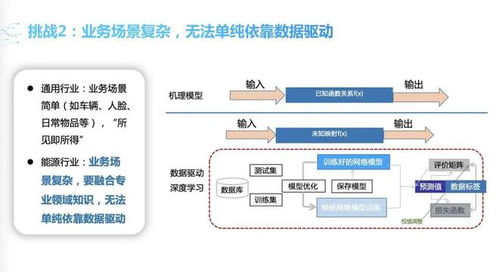

- 技術復雜性與透明度的矛盾:深度學習如同‘黑箱’,連開發者都難以完全解釋其決策過程

- 全球競爭與統一標準的落差:各國在AI倫理規范上步調不一,形成監管洼地

尋找第三條道路

面對這些挑戰,負責任的AI開發需要多管齊下:

倫理前置設計必須成為行業標準。如同建筑需要安全規范,AI系統應在開發初期就嵌入倫理考量,建立‘倫理影響評估’機制。

跨學科協作至關重要。工程師需要與哲學家、社會學家、法律專家對話,建立多元視角。微軟、谷歌等公司已設立AI倫理委員會,但這不應只是大公司的特權。

可解釋AI(XAI)研發需加速推進。只有當算法決策過程變得透明,我們才能有效監督和問責。

公眾參與不可或缺。AI將影響每個人,其發展方向不應僅由技術精英決定。通過公民論壇、倫理研討會等形式,讓社會共識引導技術發展。

在顛覆中重建

人工智能確實在顛覆我們的‘三觀’——世界觀、價值觀、人生觀。但每一次技術革命都伴隨著倫理重構。印刷術挑戰了知識壟斷,工業革命重塑了勞動倫理,互聯網改變了隱私觀念。如今,我們站在新的歷史節點,需要的不是抵制進步,而是在創新中注入更多人文關懷。

最深刻的問題或許不是‘人工智能能做什么’,而是‘我們應該用它來建設什么樣的世界’。每一次敲擊鍵盤,每一段編寫代碼,都是在回答這個問題的過程中,留下我們的選擇印記。在這個算法日益滲透生活的時代,保持對人性的堅守,或許才是最顛覆性的‘技術創新’。